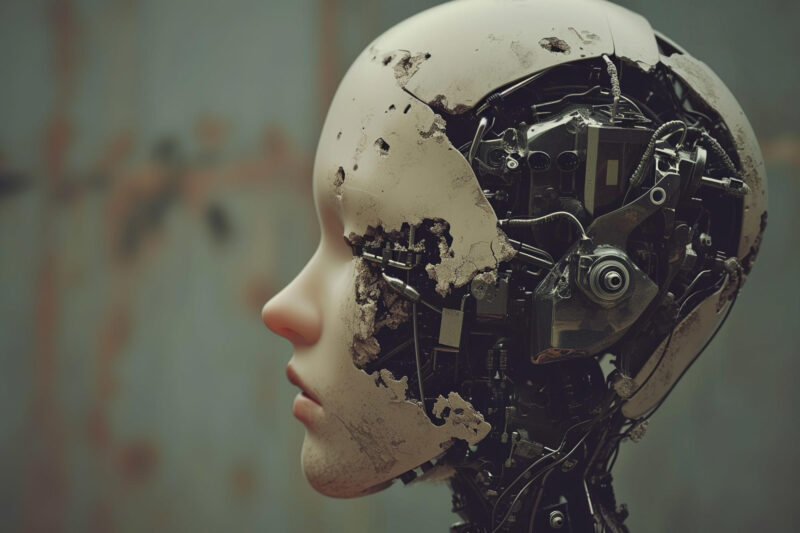

Peneliti Universitas Kopenhagen telah membuktikan bahwa algoritma Machine Learning yang benar-benar stabil tidak dapat dicapai untuk masalah yang kompleks, hal ini menyoroti pentingnya pengujian menyeluruh dan kesadaran akan keterbatasan AI. Kredit: SciTechDaily.com

Peneliti dari Universitas Kopenhagen menjadi orang pertama di dunia yang membuktikan secara matematis bahwa, selain permasalahan sederhana, tidak mungkin mengembangkan algoritma AI yang akan selalu stabil.

ChatGPT dan sejenisnya pembelajaran mesinteknologi berbasis teknologi semakin meningkat. Namun, algoritma yang paling canggih pun menghadapi keterbatasan. Para peneliti dari Universitas Kopenhagen telah membuat penemuan inovatif, yang secara matematis menunjukkan bahwa, di luar permasalahan dasar, tidak mungkin mengembangkan algoritma AI yang selalu stabil. Penelitian ini dapat membuka jalan bagi peningkatan protokol pengujian algoritma, menyoroti perbedaan inheren antara pemrosesan mesin dan kecerdasan manusia.

Sebuah artikel ilmiah yang menjelaskan hasilnya telah disetujui untuk dipublikasikan di salah satu konferensi internasional terkemuka tentang ilmu komputer teoretis.

Mesin menafsirkan gambar pemindaian medis lebih akurat dibandingkan dokter, menerjemahkan bahasa asing, dan mungkin akan segera dapat mengemudikan mobil dengan lebih aman dibandingkan manusia. Namun, algoritma terbaik sekalipun mempunyai kelemahan. Tim peneliti di Departemen Ilmu Komputer, Universitas Kopenhagen, mencoba mengungkapnya.

Ambil contoh kendaraan otomatis yang membaca rambu-rambu jalan. Jika seseorang menempelkan stiker pada tanda tersebut, hal itu tidak akan mengganggu pengemudi manusia. Namun sebuah mesin dapat dengan mudah dimatikan karena sinyal arusnya berbeda dengan sinyal yang digunakan untuk melatihnya.

“Kami ingin algoritmanya stabil dalam artian, jika masukannya diubah sedikit, keluarannya akan tetap sama. Kehidupan nyata melibatkan segala jenis kebisingan yang biasanya diabaikan manusia, sementara mesin bisa menjadi berantakan,” kata Profesor Amir Yehudayoff, yang memimpin kelompok tersebut.

Bahasa untuk membahas kelemahan

Sebagai yang pertama di dunia, kelompok ini bersama peneliti dari negara lain telah membuktikan secara matematis bahwa selain permasalahan sederhana tidak mungkin tercipta algoritma Machine Learning yang akan selalu stabil. Artikel ilmiah yang menjelaskan hasilnya telah disetujui untuk dipublikasikan di salah satu konferensi internasional terkemuka tentang ilmu komputer teoretis, Foundations of Computer Science (FOCS).

“Saya ingin mencatat bahwa kami belum mengerjakan secara langsung aplikasi mobil otomatis. Namun, hal ini tampaknya merupakan masalah yang rumit sehingga algoritmanya tidak selalu stabil,” kata Amir Yehudayoff, seraya menambahkan bahwa hal ini tidak serta merta menimbulkan konsekuensi besar dalam kaitannya dengan pengembangan mobil otomatis:

“Jika algoritme hanya mengalami kesalahan dalam beberapa keadaan yang sangat jarang terjadi, hal ini mungkin dapat diterima. Namun jika hal ini terjadi di banyak situasi, maka ini adalah kabar buruk.”

Artikel ilmiah tidak dapat diterapkan oleh industri untuk mengidentifikasi bug dalam algoritmanya. Ini bukanlah maksudnya, sang profesor menjelaskan:

“Kami sedang mengembangkan bahasa untuk mengatasi kelemahan algoritma Machine Learning. Hal ini dapat mengarah pada pengembangan pedoman yang menjelaskan bagaimana algoritma harus diuji. Dan dalam jangka panjang, hal ini mungkin akan mengarah pada pengembangan algoritma yang lebih baik dan lebih stabil.”

Dari intuisi hingga matematika

Penerapan yang mungkin dilakukan adalah menguji algoritma untuk perlindungan privasi digital.

”Beberapa perusahaan mungkin mengklaim telah mengembangkan solusi yang benar-benar aman untuk perlindungan privasi. Pertama, metodologi kami dapat membantu membuktikan bahwa solusi yang diberikan tidak sepenuhnya aman. Kedua, ini akan mampu menunjukkan titik lemah,” kata Amir Yehudayoff.

Namun, yang pertama dan terpenting, artikel ilmiah berkontribusi pada teori. Terutama konten matematisnya yang inovatif, tambahnya: “Kami memahami secara intuitif, bahwa algoritma yang stabil akan bekerja hampir sama baiknya dengan sebelumnya ketika terkena sejumlah kecil input noise. Ibarat rambu lalu lintas yang ditempel stiker. Namun sebagai ilmuwan komputer teoretis, kita memerlukan definisi yang tegas. Kita harus mampu menggambarkan permasalahan tersebut dalam bahasa matematika. Berapa banyak noise yang harus dapat ditahan oleh algoritme, dan seberapa dekat dengan keluaran asli yang kita inginkan agar algoritme tersebut stabil? Ini adalah jawaban yang kami usulkan.”

Penting untuk mengingat batasan

Artikel ilmiah ini mendapat perhatian besar dari rekan-rekan di dunia teori ilmu komputer, namun tidak dari industri teknologi. Setidaknya belum.

“Anda harus selalu mengharapkan adanya penundaan antara perkembangan teoretis baru dan minat orang-orang yang bekerja di bidang aplikasi,” kata Amir Yehudayoff, sambil menambahkan sambil tersenyum: “Dan beberapa perkembangan teoretis akan luput dari perhatian selamanya.”

Namun, dia tidak melihat hal itu terjadi dalam kasus ini: “Machine Learning terus mengalami kemajuan pesat, dan penting untuk diingat bahwa bahkan solusi yang sangat sukses di dunia nyata pun masih memiliki keterbatasan. Mesin terkadang tampak mampu berpikir, namun bagaimanapun juga, mereka tidak memiliki kecerdasan manusia. Ini penting untuk diingat.”

Referensi: “Replikasi dan Stabilitas dalam Pembelajaran” oleh Zachary Chase, Shay Moran dan Amir Yehudayoff, 2023, konferensi Foundations of Computer Science (FOCS).

DOI: 10.48550/arXiv.2304.03757

NewsRoom.id